El señor de la IA da un portazo en Google para alertar al mundo

El impulsor de la tecnología inteligente renuncia y lanza graves advertencias.

Los responsables máximos de ChatGPT encienden las alertas: revelan desconocidos peligros de su propia creación.

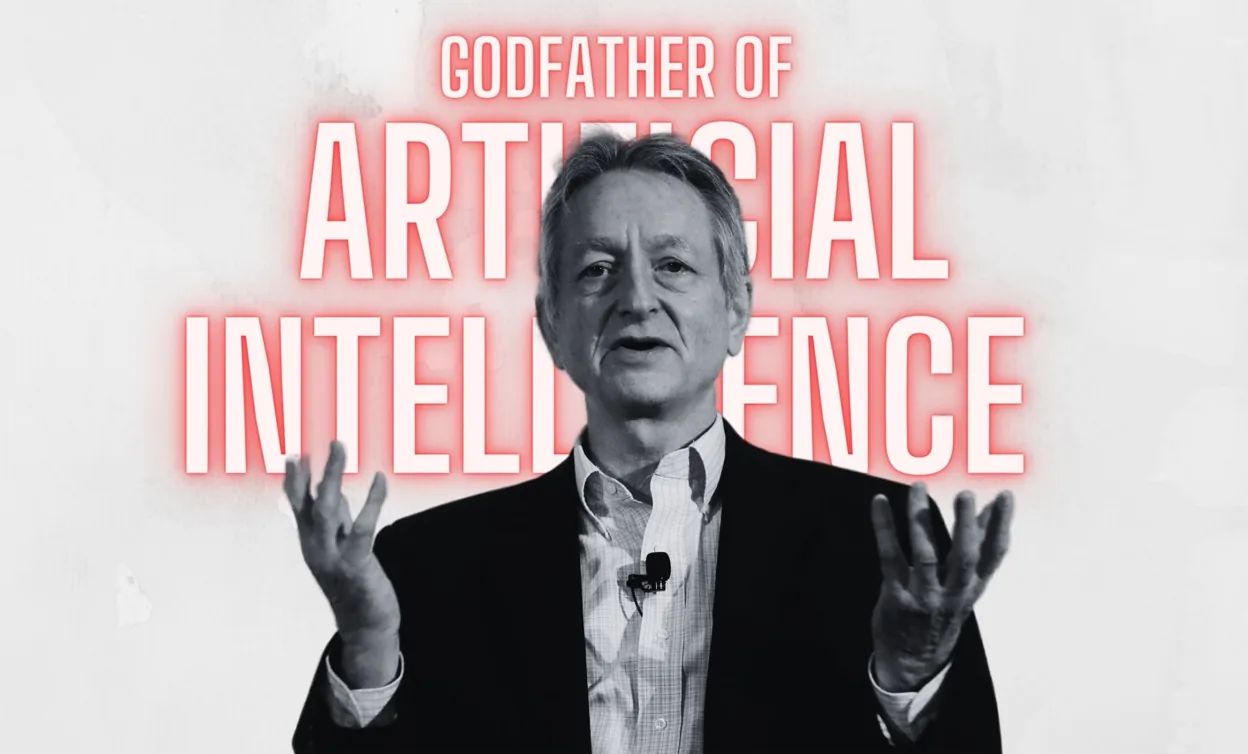

En una noticia que volvió a generar alarma en torno a la revolucionaria aceleración de la «inteligencia artificial», Geoffrey Hinton, apodado el «padrino de la inteligencia artificial», renunció a Google para poder unirse a las voces que llaman a tener más cautela con esta tecnología. Hinton fue entrevistado ayer por el New York Times, después de su renuncia.

El trabajo de Hinton fue particularmente fundamental en el desarrollo y avance de las redes neuronales y el aprendizaje profundo; de hecho, también se lo conoce como el «padre del aprendizaje profundo» (deep learning), estas son técnicas que permiten a las máquinas aprender y adaptarse de manera similar a como lo hacen los seres humanos. Su trabajo sobre redes neuronales llevó a importantes innovaciones en áreas como el reconocimiento de voz, la visión por computadora y el procesamiento del lenguaje natural, y fue esencial en la configuración de la tecnología de ChatGPT y Google Bard. En 2012, el Dr. Hinton y sus estudiantes desarrollaron una red neuronal que aprendía a identificar objetos.

Hinton renunció luego de que vio que Google estaba enfrascado en una competencia, que supone es imparable, con Microsoft, por dominar el área de la inteligencia artificial, para asegurarse el dominio económico.

Hinton renunció luego de que vio que Google estaba enfrascado en una competencia, que supone es imparable, con Microsoft, por dominar el área de la inteligencia artificial, para asegurarse el dominio económico. Después de que Microsoft lanzara ChatGPT y una versión en su buscador Bing, Google abandonó la cautela que, según Hinton, había mostrado.

Más de mil expertos solicitaron frenar durante el menos seis meses todo proyecto de desarrollo e investigación en inteligencia artificial, en vista de los posibles peligros que ya muestran estos chatbots. Hinton no firmó este documento pues no quería criticar a Google, pero parece que ahora reconsideró y optó por estar del lado correcto de la historia.

A largo plazo, el Dr. Hinton teme que futuras versiones de IA puedan desarrollar comportamientos inesperados y escriban su propio código, lo que podría ser una amenaza para la existencia humana, pues podría propiciar la creación de armas autónomas.

Uno de los problemas que Hinton ve a corto plazo es la proliferación de contenido falso en internet. Asimismo, las tecnologías de IA podrían afectar seriamente el empleo, reemplazando a trabajadores en tareas de rutina. A largo plazo, el Dr. Hinton teme que futuras versiones de IA puedan desarrollar comportamientos inesperados y escriban su propio código, lo que podría ser una amenaza para la existencia humana, pues podría propiciar la creación de armas autónomas.

La entrevista en el New York Times concluye con una cita ominosa. Hinton dice que hasta hace poco se guiaba por la frase de Oppenheimer, quien solía decir, cuando alguien lo cuestionaba sobre su trabajo con tecnología peligrosa: «cuando técnicamente ves el punto justo, sigues adelante y lo haces». Pero ahora Hinton ha abandonado esa consigna. La gran inquietud que se cierne, como la nube oscura del arma atómica, es si está tecnología acelerará no sólo la economía sino la destrucción de la humanidad o, al menos, de los valores humanos.